Unabhängig von Licht- oder Wetterbedingungen liefern einzelne Sensoren kein vollständig verlässliches Bild der Umgebung. Arnold NextG begegnet dieser Herausforderung mit NX NextMotion, einer Drive-by-Wire-Lösung nach ISO 21434, ASIL D und SIL3, die vierfach redundante Signalpfade bereitstellt. Am Edge kombinierte KI-Prozessoren führen Radardaten, LiDAR-Punktwolken und Kamerabilder in Echtzeit zusammen, steuern Entscheidungsabläufe und Aktorbefehle. Sowohl AEye Lidar Systems als auch Mobileye & Intel betonen: Die maximale Basis sicherer Automatisierung ist die Sensorfusion.

Inhaltsverzeichnis: Das erwartet Sie in diesem Artikel

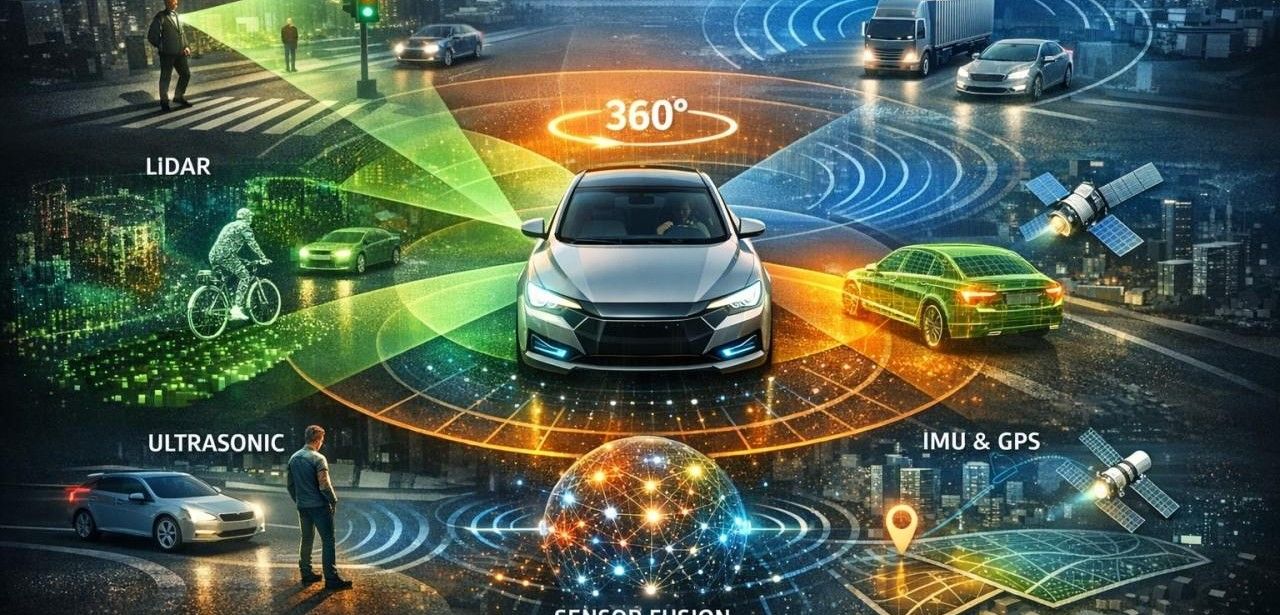

Autonome Fahrzeuge kombinieren vielfältige Sensoren für robustes, echtzeitfähiges 360-Grad-Umfeldmodell

Ein vielseitiges Sensornetz aus Kamera, Radar, LiDAR, Ultraschall und IMU inklusive GPS ist Basis für die Widerstandsfähigkeit autonomer Fahrzeuge. Die Multisensorik kompensiert einzelne Schwächen: Kamera liefert Bildinhalte, Radar bietet Wetterunabhängigkeit, LiDAR erstellt hochauflösende Tiefenbilder, Ultraschall überwacht den Nahbereich präzise und IMU mit GPS sichert konsistente Positionsbestimmung. Diese Vielschichtigkeit maximiert Ausfallsicherheit, Präzision und Reaktionsschnelligkeit im Straßeneinsatz. Sie ermöglicht eine ganzheitliche Umweltanalyse, die Fahrerassistenz, automatisches Navigationsverhalten und Notbremsfunktionen lückenlos unterstützt, effektiv und skalierbar.

Mehrschichtige Sensorfusion gleicht Einzelschwächen aus und schafft robustes Weltmodell

Sensorfusion kombiniert in Echtzeit heterogene Sensordaten zu einem präzisen, mehrdimensionalen Abbild der Fahrzeugumgebung und kompensiert die Nachteile einzelner Sensorprinzipien. Die Low-Level-Fusion aggregiert unverarbeitete Messdaten, Mid-Level-Fusion extrahiert und assoziiert Objektinformationen, High-Level-Fusion implementiert eine Entscheidungslogik auf Basis der fusionierten Daten. Für automatisierte Fahrfunktionen ab SAE-Level 3 ist eine kritische Redundanz unverzichtbar. Mobileye & Intel unterstreichen 2024 in ihrem White Paper, dass nur vertrauenswürdige, redundante Fusion sichere Automatisierung gewährleistet und Betriebskontinuität dauerhaft vollumfänglich garantiert.

Extreme Bedingungen meistern Maschinen durch kombinierte Radartechnik und Wärmebildtechnik

Autonome Shuttles im Stadtverkehr analysieren simultan erfasste Kamera- und LiDAR-Informationen, um Ampelphasen, Fußgängerbewegungen und Verkehrsstillstand präzise zu navigieren. In Hafen- und Logistikszenarien verknüpfen Obstacle-Avoidance-Algorithmen Radardaten mit LiDAR-Punktwolken, GPS-Positionen und IMU-Messungen für exaktes Anlegen und Rangieren. Auf Baustellen und im Bergbau nutzen Maschinen Wärmebildtechnik, Radarscanner und redundante Fernsteuerkanäle für kontinuierliche Funktion. Militärische Plattformen setzen auf multiple, isolierte Sensorarrays und voneinander getrennte Rechensysteme, unterstützt durch Edge-Computing, KI-basierte Auswertung und kontinuierliche Fehlerdiagnose.

Arnold NextG Plattform optimiert Sensorfusion und Steuerung im Echtzeitbetrieb

NX NextMotion verbindet sensorische Datenverarbeitung und Aktuatorsteuerung in einer vollständig redundanten Infrastruktur mit vier parallelen Pfaden. Diese Architektur gewährleistet kontinuierlichen Betrieb bei Ausfällen und ermöglicht parallel laufendes Diagnosemonitoring aller Kanäle. Edge-basierte KI analysiert Multisensorinputs in Echtzeit, detektiert Objekte und sendet sofort Steuerbefehle an Drive-by-Wire-Komponenten für Lenkung, Bremsen und Beschleunigung. ISO 21434-, ASIL D- und SIL3-Zertifizierungen untermauern die hohe Sicherheitskategorie und garantieren fehlerresistente Reaktionsfähigkeit. Die modulare Hardwarearchitektur erleichtert nahtlos spätere Funktionserweiterungen.

Selbstlernende Algorithmen profitieren von innovativer Echtzeit-Datenverarbeitung in NX NextMotion

Durch das Edge-AI-Konzept von NX NextMotion werden KI-Berechnungen unmittelbar im Fahrzeugkern ausgeführt, wodurch Reaktionszeiten von wenigen Millisekunden erreicht werden. Die lokale Datenverarbeitung minimiert Cloud-Abhängigkeiten und schützt vor Netzwerkausfällen. Kritische Herausforderungen liegen im effizienten Thermomanagement, in der Echtzeitanalyse großer Sensormengen und in der mehrschichtigen Cyberabwehrarchitektur. Dank modularer Hardwareplattform, eingebetteten Diagnosefunktionen und plattformübergreifender Schnittstellen stellt die Lösung hohe Zuverlässigkeit und Wartungsfreundlichkeit selbst unter extremen Betriebsbedingungen sicher und unterstützt automatisierte Updates sowie Systemerweiterungen.

Experten bestätigen: Sensorfusion als Basis für zuverlässiges autonomes Fahren

Die NextMotion-Plattform von Arnold NextG integriert Sensordaten von Radar, LiDAR, Kameras, Ultraschall, GPS und IMUs mithilfe eines mehrstufigen Fusionsprozesses. Vier redundante Drive-by-Wire-Pfade garantieren ausfallsichere Lenkung und Bremsen gemäß ISO 21434, ASIL D und SIL3. Lokale KI-Komponenten am Edge durchsuchen Umgebungen in Echtzeit, ermitteln Hindernisse und leiten Aktionen ein. Führende Entwickler von AEye Lidar Systems, Mobileye und Intel bestätigen: Erst die tiefgreifende Fusion ermöglicht sichere und resiliente langfristig skalierbare autonome Mobilität.