Als neuer Technology Partner der VAST Cosmos Community integriert Mirantis das VAST KI-Betriebssystem nahtlos in k0rdent AI. Diese Kooperation beseitigt manuelle Integrationshemmnisse und ermöglicht die Bereitstellung wiederholbarer Kubernetes-nativer Deployment-Pattern. Neocloud-Betreiber erreichen dadurch eine gesteigerte GPU-Auslastung und beseitigen Storage-Engpässe durch dynamische Datendienste. Der standardisierte Pfad reduziert Komplexität, senkt Betriebskosten, beschleunigt das Scaling und sorgt für zuverlässige, performante KI-Workflows mit maximaler Infrastrukturökonomie. Die Zusammenarbeit folgt bewährten NVIDIA-Referenzarchitekturen für konsistente Sicherheit und Performance.

Inhaltsverzeichnis: Das erwartet Sie in diesem Artikel

Neocloud-Betreiber optimieren Integrationsaufwand durch standardisierte VAST-Anbindung im k0rdent AI

In der neuen Technology Partnership vereinen Mirantis und VAST Data ihre Kernkompetenzen, um das VAST Cosmos Community-Ökosystem für k0rdent AI zu erweitern. Das gemeinsame Ziel: einen Referenz-Integrationspfad bereitzustellen, der Komplexität reduziert, Wiederholbarkeit fördert und die Bereitstellung von GPU-beschleunigten KI-Diensten beschleunigt. Anwender profitieren von validierten Architekturmustern, Kubernetes-nativer Automatisierung und nahtlos integrierten Datendiensten. Auf diese Weise lassen sich Multi-Vendor-Infrastrukturen effizienter betreiben und flexibel skalieren. Sie etabliert Best Practices und fördert effiziente Innovationszyklen.

Wiederholbare Prozesse ersetzen individuelle Lösungen bei k0rdent Integration jetzt

Der standardbasierte Ansatz von Mirantis und VAST Data ermöglicht die direkte Integration des VAST KI-Betriebssystems in die k0rdent AI Umgebung. Statt individuell programmierter Schnittstellen kommen reproduzierbare Prozessvorlagen zum Einsatz, die den Aufwand für Ad-hoc-Integrationen reduzieren. Die modulare Architektur von k0rdent AI vereinfacht die Zusammenführung von Compute-, Netzwerk- und Speicherinfrastrukturen. VAST Data ergänzt dies durch hochperformante Datendienste, wodurch Datendurchsatz und GPU-Auslastung optimiert und Betriebskosten verringert werden. Für agile und skalierbare KI-Plattformen.

Fokus auf Ergebnisse ermöglicht Neocloud-Betreibern schnellere Bereitstellung von Hochleistungs-KI-Services

Kevin Kamel, Vice President of Product Management bei Mirantis, unterstreicht, dass Neocloud-Anbieter angesichts zunehmender KI-Workloads unter enormem Druck stehen, ihre GPU-Kapazitäten vollständig zu nutzen. Die gemeinsame Lösung reduziert Integrationshürden durch standardisierte Schnittstellen und Automatisierung. Dies führt zu deutlich schnellerer Skalierung sowie optimiertem Ressourceneinsatz. IT-Teams gewinnen mehr Zeit für strategische Aufgaben und können KI-basierte Dienste in kürzerer Zeit mit höherer Performance und verbesserter Wirtschaftlichkeit bereitstellen. Die Gesamtbetriebskosten sinken messbar und Skalierungsvorteile.

VAST Data Dienst-Framework beseitigt effizient nahtlos Storage-Engpässe für KI-Workflows

Heutige KI-Stacks verlieren häufig durch ineffiziente Speicherzugriffe und fragmentierte Datenpipelines wertvolle GPU-Leistung, während Integrationsaufwand steigt. VAST Data antwortet mit einem modularen Datendienst-Framework, das Training, Low-Latency-Inferenz und agentische KI-Workloads lückenlos unterstützt. In Kombination mit k0rdent AI basiert der resultierende Stack auf NVIDIA-geführten Referenzarchitekturen, automatisierter Kubernetes-Orchestrierung und validierten Komponenten, um Daten-Durchsatz zu erhöhen, GPU-Auslastung zu maximieren sowie Betriebskosten und Komplexität nachhaltig zu senken. Er liefert reproduzierbare Deployment-Muster, Skalierung und verbesserte Systemstabilität proaktiv.

Mirantis und VAST Data optimieren Sicherheit, Vorhersehbarkeit im KI-Betrieb

Mirantis und VAST Data engagieren sich in übergreifenden Ökosystem-Projekten, um NVIDIA-geführte Referenzarchitekturen für anspruchsvolle GPU-Cluster zu validieren. Die erstellten Musterbeschreibungen bieten präzise Vorgaben für die Integration von Rechenknoten, Netzwerk-Backbones und skalierbaren Speichersystemen. Anwender greifen auf geprüfte Bausteine zurück, die den Aufwand individueller Entwicklungen reduzieren und standardisierte Qualität gewährleisten. Dies führt zu planbaren Betriebskonzepten, erhöhtem Datenschutz und einer stabilen Grundlage für künftige KI-Innovationen. So entstehen robuste Plattformen mit Skalierbarkeit und Kostenkontrolle.

Standardisierte Integrationspfade beschleunigen deutlich Kubernetes-Deployments und optimieren GPU-Leistung effektiv

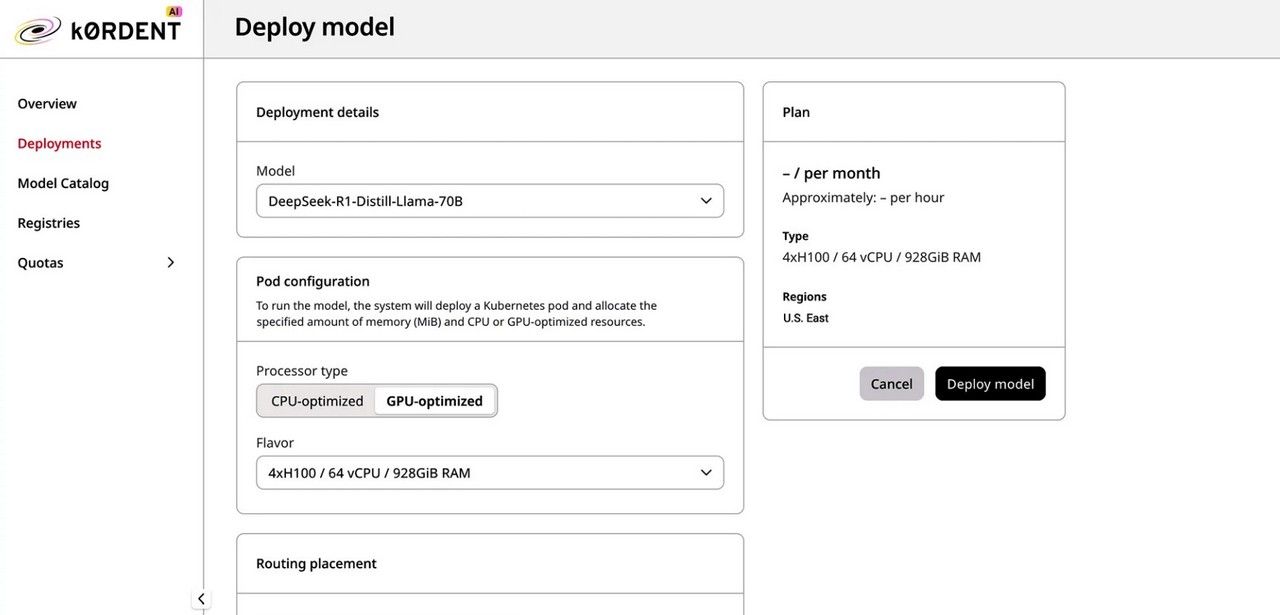

Kubernetes-basierte KI-Stacks in Neoclouds lassen sich mit k0rdent vollständig automatisieren. Standard-Deployments definieren Infrastruktur-Topologien, Netzwerk- und Storage-Konfigurationen vor, sodass keine manuellen Eingriffe mehr erforderlich sind. Die native Steuerungslogik übernimmt Rollouts, Updates und Backups unter Berücksichtigung der GPU-Ressourcenauslastung. Betreiber profitieren von konsistenten Umgebungen, minimierten Konfigurationsfehlern und beschleunigter Implementierung neuer KI-Services. Diese End-to-End-Automatisierung erhöht sowohl Betriebssicherheit als auch Ressourceneffizienz und verkürzt deutlich die Time-to-Scale. Änderungspipeline integriert CI/CD-Prozesse nativ. Skalierung erfolgt adaptiv an Nachfrage.

VAST Data integriert dynamische Datendienste nahtlos in k0rdent AI

Mirantis und VAST Data orientieren sich an NVIDIA-geführten Referenzarchitekturen, um bewährte Deployment-Muster für KI-Umgebungen zu bieten. Betreiber profitieren von validierten Bauplänen, die Compute, Netzwerk und Storage effizient kombinieren und so letzte Integrationshürden abbauen. Kubernetes-native Tools automatisieren Skalierung und Ressourcenverteilung, maximieren dabei GPU-Auslastung und minimieren Betriebskosten. Der standardisierte Ansatz unterstützt konsistente Performance, verkürzt Time-to-Value und ermöglicht Unternehmen, Hochleistungs-KI-Workloads schnell, zuverlässig und wirtschaftlich in Produktion zu nehmen. mit transparentem Monitoring und Fehlerbehebung.